【环球网科技报道 记者 李文瑶】4月8日消息,近日,SentiPulse(思维光谱)联合中国人民大学高瓴人工智能学院博士生团队,正式开源国内首个交互式3D数字人框架——SentiAvatar,并同步开源配套3D数字人角色模型SUSU及高质量中文多模态对话动作数据集SuSuInterActs,旨在解决3D数字人交互中动作与语义脱节、表情僵硬、节奏错位等行业痛点。

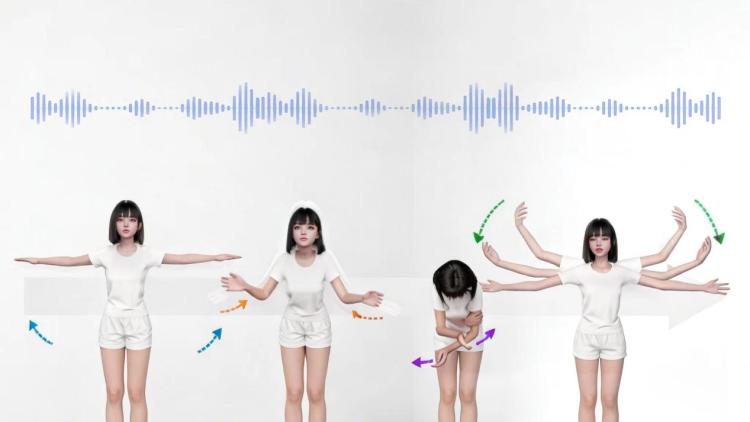

SentiAvatar生成的高质量3D人体动作与表情,由数字人SUSU呈现

SentiAvatar生成的高质量3D人体动作与表情,由数字人SUSU呈现

长期以来,3D数字人因动作不自然、情感表达缺失,易让用户陷入“恐怖谷”效应。其背后缺乏高质量中文全身动作数据、复合语义下动作生成漂移及语音节奏错位等问题。

此次开源的SentiAvatar框架实现了多项技术突破:通过光学动作捕捉构建的SuSuInterActs数据集,包含2.1万段对话片段,总时长37小时,填补了中文对话场景下3D数字人高质量-动作数据的空白;自研动作基础模型在超20万条异质动作序列上训练,提升了复合语义理解能力;提出“plan-then-infill”架构,将语义规划与韵律驱动解耦,实现动作与语音的精准对齐。

在SuSuInterActs和BEATv2数据集上,SentiAvatar均达到当前最优水平,动作生成效果优于全球主流文生3D动作模型。目前该框架已在GitHub开源,可应用于游戏交互、影视制作、机器人等领域。